Épisode 3, le 22 mai 2025

La gouvernance des données ne se résume pas aux contraintes de conformité règlementaires et de choix d’outils. Elle repose avant tout sur une organisation claire, structurée où les responsabilités sont établies, partagées, comprises et respectées. Pour les grandes entreprises, la mise en place d’une organisation Data efficace est un pré requis indispensable pour industrialiser et sécuriser les usages de la donnée.

Dans ce troisième épisode, nous vous proposons d’entrer dans le détail des différents rôles essentiels à une bonne gouvernance des données, les interactions entre métiers, IT et conformité, ainsi que les modèles organisationnels les plus adaptés.

Les rôles clés pour une gouvernance des données efficace

Une organisation de la gouvernance des données repose sur une répartition précise des rôles et des responsabilités. Chaque acteur joue un rôle clé dans le cycle de vie et la qualité des données.

Chief Data Officer (CDO)

Le Chief Data Officer définit et pilote la stratégie data de l’entreprise. Il fixe les priorités, les standards de gouvernance et arbitre les décisions structurantes. Rattaché à la direction générale ou au COMEX, il assure l’alignement entre objectifs métier, contraintes réglementaires et capacités IT.

Data Owner

Le Data Owner est le responsable métier d’un domaine de données. Il définit les règles d’usage, les indicateurs de qualité et veille à la conformité des données sous sa responsabilité. Il est souvent issu d’une direction fonctionnelle (finance, marketing, RH…).

Data Steward

Le Data Steward est en charge de la mise en œuvre opérationnelle des règles de gouvernance. Il contrôle la qualité des données, documente les jeux de données dans les catalogues, identifie les anomalies et coordonne les actions correctives.

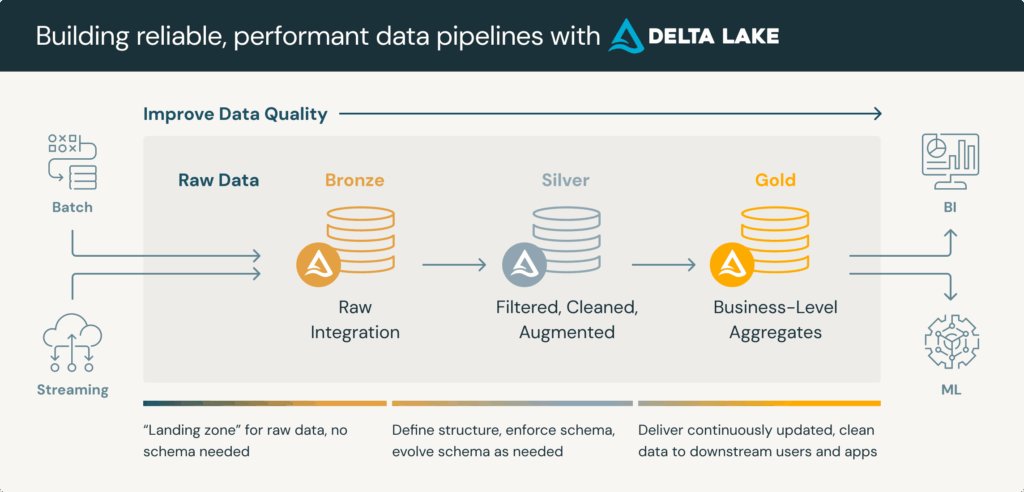

Data Architect / Data Engineer

Ces profils techniques conçoivent l’architecture de circulation et de stockage des données. Ils garantissent la cohérence, l’accessibilité et la scalabilité des systèmes de données dans un environnement devenu essentiellement hybride chez la plupart de nos clients (on-premise / cloud).

DPO, RSSI, Compliance Officer…

La gouvernance des données implique également des fonctions support : juridiques (DPO), sécurité (RSSI), conformité réglementaire. Ces parties prenantes contribuent à encadrer les risques associés aux données (RGPD, Data Act, IA Act…).

| Rôle | Responsabilités principales |

| Chief Data Officer (CDO) | Définit et pilote la stratégie data, supervise la qualité, la conformité et l’usage des données. |

| Comité de gouvernance data | Regroupe des représentants métiers, IT, conformité ; définit et valide les politiques et priorités |

| Data Owner | Responsable de la donnée dans un domaine métier, garantit la qualité et la conformité de ses données. |

| Data Steward | Gère la donnée au quotidien, s’assure de la bonne application des règles et de la qualité. |

| Data Protection Officer (DPO) | Garantit la conformité réglementaire (ex : RGPD), supervise la protection des données personnelles |

| Utilisateurs métiers | Exploitent les données, signalent les anomalies, participent à l’amélioration continue. |

Une collaboration transverse : IT, métiers, conformité et direction générale

La gouvernance des données ne peut pas réussir sans une collaboration étroite entre les différentes fonctions de l’entreprise. Il est nécessaire de briser les silos traditionnels pour instaurer une gouvernance partagée :

- Les métiers expriment les besoins, définissent les usages, apportent leur expertise fonctionnelle.

- La DSI fournit les outils, les plateformes et veille à la performance technique de la gouvernance.

- Les équipes conformité encadrent les exigences légales et réglementaires.

- La direction générale sponsorise la démarche, en assure la légitimité et l’intégration dans les objectifs stratégiques.

Cette gouvernance partagée nécessite un alignement fort et une communication continue entre les acteurs. La mise en place de comités (Data Governance Council) permet cette coordination.

Modèles centralisé, décentralisé ou fédéré : quel modèle pour organiser la gouvernance des données ?

Le choix du modèle organisationnel dépend de la maturité data de l’entreprise, de sa taille, et de son mode de fonctionnement (centralisé, multi-BU, international…).

Modèle centralisé

La gouvernance est pilotée par une équipe dédiée au siège, qui définit les politiques, les rôles et supervise l’ensemble des opérations. Ce modèle convient aux organisations intégrées, avec un système d’information unifié.

Avantages :

- Cohérence des règles et des pratiques

- Vision globale des enjeux data

Limites :

- Éloignement des réalités métier

- Moins de flexibilité locale

Modèle décentralisé

Chaque entité métier ou géographique gère ses propres données selon ses spécificités. Les rôles sont dupliqués localement, avec des pratiques potentiellement hétérogènes.

Avantages :

- Autonomie des équipes

- Réactivité face aux besoins spécifiques

Limites :

- Risque de fragmentation

- Difficulté de pilotage transverse

Modèle fédéré (hybride)

C’est souvent le modèle privilégié par la plupart de nos clients : la gouvernance est définie globalement, mais déployée localement. Le CDO pilote la stratégie, tandis que des relais (Data Champions) la déclinent dans les entités opérationnelles.

Avantages :

- Équilibre entre homogénéité et agilité

- Meilleure appropriation locale des pratiques

Limites :

- Nécessite une coordination forte

- Exige des ressources compétentes à tous les niveaux

Les bénéfices d’une organisation Data structurée

Une structuration claire, dotée de rôles définis et d’interactions fluides, permet à l’entreprise de sécuriser ses données, de gagner en efficacité et de mieux exploiter son capital informationnel.

Sécurisation et conformité

Une organisation Data bien définie réduit significativement les risques de non-conformité et les expositions aux sanctions réglementaires. En clarifiant les responsabilités (notamment celles du DPO, des Data Owners et des responsables sécurité), l’entreprise est mieux préparée pour répondre aux exigences du RGPD, du Data Act ou encore de l’IA Act.

Elle est également plus résiliente face aux risques de fuites, de malveillance ou d’usages non maîtrisés des données.

Qualité et fiabilité

La structuration des rôles permet une meilleure gouvernance de la qualité des données. Les Data Stewards, en lien avec les métiers, assurent un suivi continu de la fiabilité, de la complétude et de la cohérence des données.

Cette amélioration directe de la qualité permet une prise de décision plus éclairée, une performance accrue des processus opérationnels et une meilleure expérience client.

Efficacité opérationnelle

Une gouvernance des données bien orchestrée élimine les redondances, les incohérences de traitement et les conflits d’usage entre les départements. Elle favorise la mise en place de référentiels partagés, de processus harmonisés, et d’outils interopérables.

Résultat : une réduction des coûts liés à la gestion de la donnée, une meilleure collaboration entre les équipes IT et métiers, et un gain global de productivité.

Bonnes pratiques pour une bonne organisation et une gouvernance des données efficace

- Clarifiez les rôles dès le départ : chaque acteur doit comprendre son périmètre et ses responsabilités pour éviter les conflits, les incohérences et les failles de conformité.

- Documentez les processus dans un référentiel commun (charte de gouvernance, politique de qualité des données…).

- Installez un Data Governance Council ou Comité de gouvernance incluant toutes les parties prenantes pour piloter les arbitrages stratégiques.

- Formez les collaborateurs aux enjeux de la gouvernance des données : acculturation, responsabilité de chacun, maîtrise des outils.

- Adaptez votre modèle organisationnel au contexte de votre entreprise (structure, culture, maturité data…).

- Suivez les indicateurs de performance (KPIs) pour évaluer l’efficacité de la gouvernance et ajuster la stratégie.

Outils de gouvernance des données : comment intégrer votre organisation dans la solution ?

Les outils ne se contentent plus d’être de simples référentiels, ils sont désormais de véritables plateformes de gouvernance opérationnelle, capables de refléter et d’accompagner l’organisation Data de l’entreprise. Leur bonne utilisation suppose néanmoins d’avoir, en amont, défini les rôles et l’organisaton. Les plateformes actuelles de Data Governance, Data Catalog ou Master Data Management (MDM) permettent de :

1. Définir et affecter les rôles

- Attribution des rôles clés comme Data Owner, Data Steward, CDO, DPO, etc.

- Paramétrage des droits d’accès et des responsabilités dans l’outil.

- Gestion fine des périmètres de responsabilité (par domaine de données, BU, région…).

2. Suivre les responsabilités et les actions

- Suivi des actions correctives menées par les Data Stewards.

- Notifications automatiques en cas d’écarts de qualité, d’anomalies ou de non-conformité.

- Workflows intégrés pour validation, correction ou escalade selon les responsabilités définies.

3. Représenter l’organisation et sa gouvernance

- Possibilité de modéliser des structures hiérarchiques (gouvernance centralisée, fédérée, etc.).

- Définition de groupes de gouvernance, comités, ou data domains avec leur pilotage associé.

- Vision transverse des rôles dans le data lineage, les glossaires, les règles de gestion.

SOLUTIONS

- Collibra : gestion avancée des rôles et responsabilités, cartographie des workflows de gouvernance.

- Informatica : intégration native des stewards et owners, avec lien vers les règles de qualité.

- Alation : attribue automatiquement les rôles en fonction des usages observés ; très fort sur la collaboration entre équipes.

- Ataccama, Semarchy, Talend Data Fabric, DataGalaxy (Français !) : tous proposent des modèles de rôles et des intégrations avec Active Directory / SSO pour s’aligner avec les structures existantes.

En bref

Mettre en place une organisation orientée data est structurant pour inscrire durablement la gouvernance des données dans l’entreprise. Cela implique de définir clairement les rôles et responsabilités, de favoriser une collaboration étroite entre les différentes fonctions (métier, IT, conformité), et d’adopter un modèle organisationnel adapté à la complexité et à la maturité de l’organisation.

Une gouvernance efficace repose avant tout sur une structure lisible, des acteurs identifiés (CDO, Data Owner, Data Steward, DPO, etc.) et des processus partagés. En structurant ainsi l’organisation autour de la donnée, l’entreprise sécurise son patrimoine informationnel, gagne en agilité, et crée les conditions d’un usage industrialisé, fiable et responsable de la donnée.

Smartpoint vous recommande

Avant de choisir un outil, assurez-vous que :

- La solution retenue est interopérable avec vos outils SI et référentiels existants.

- Vos rôles sont clairement définis dans une charte de gouvernance.

- Vos processus sont documentés et cartographiés.

- Le modèle organisationnel cible est aligné avec votre structure (BU, filiales, multi-cloud).

Architecture Data IA, modernisation plateforme data, gouvernance des données, analytics avancés ou renfort projet : que vous cherchiez un partenaire conseil ou des experts opérationnels,

Smartpoint vous accompagne, en mission comme en expertise.

Les champs obligatoires sont indiqués avec *.