Estimated reading time: 11 minutes

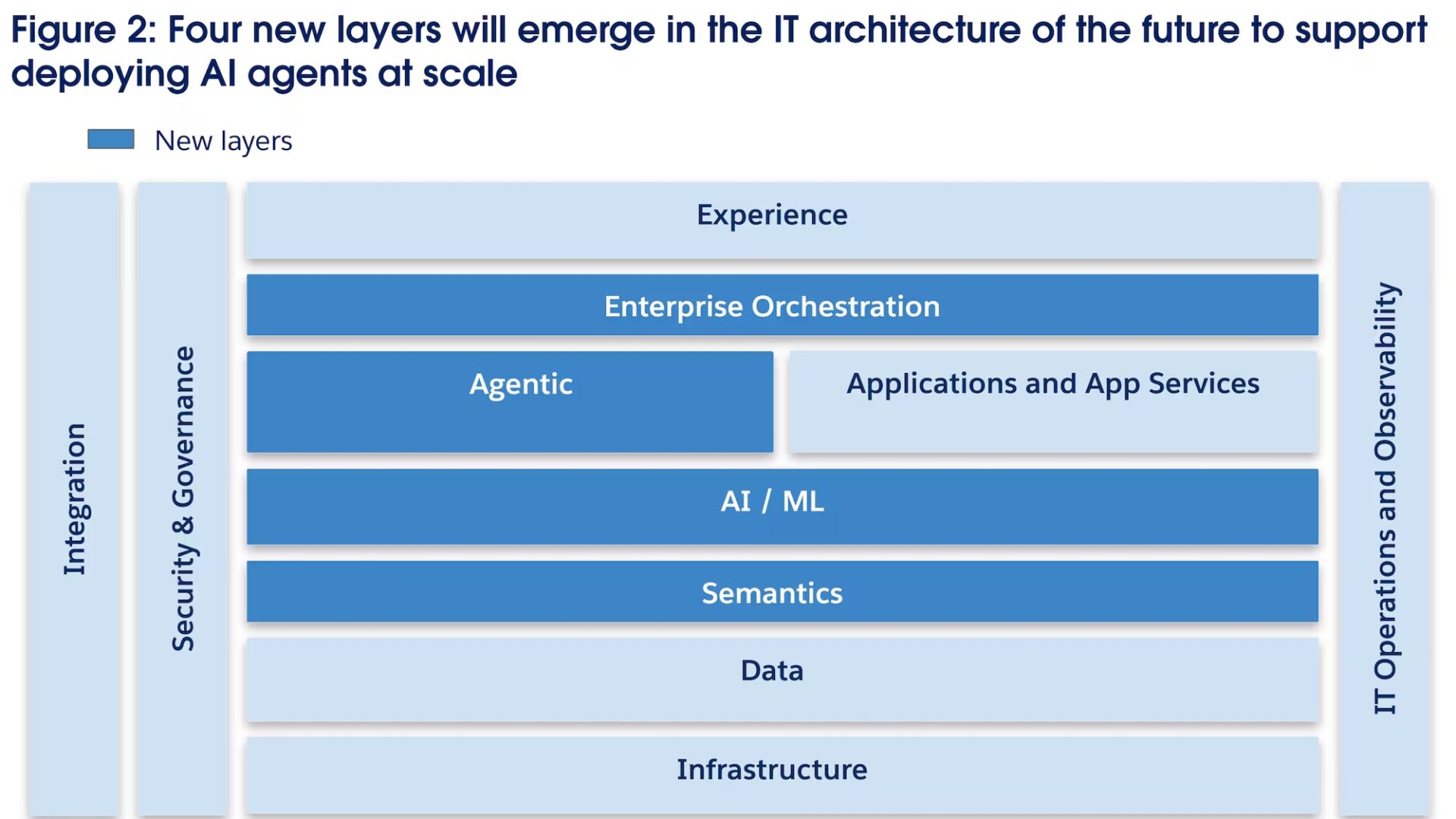

Le temps des POC IA (Proof of Concept) est désormais derrière nous. En 2026, il ne s’agit plus de démontrer qu’une IA peut répondre à une question mais de garantir qu’elle peut le faire à l’échelle du SI de manière performante et sécurisée dans la durée. Chez Smartpoint, nous constatons en effet que la réalité des projets est plus compliquée ! 51% des organisations utilisant l’IA déclarent avoir déjà subi au moins un effet négatif et indésirable, allant de la simple hallucination à l’erreur de tarification. Cette statistique, issue de l’étude McKinsey & Company, The state of AI in 2025: Agents, innovation, and transformation, souligne l’urgence d’une approche plus industrielle. Pour éviter que vos projets IA ne rejoignent les 30% de déploiements GenAI abandonnés après la phase de test (source Gartner), principalement en raison d’une mauvaise qualité des données ou de coûts d’exploitation mal maîtrisés, voici les conseils de nos consultants Data / IA.

Modernisation SI Data et plateforme BI : les fondamentaux d’une IA à l’échelle

Concevoir un RAG sur une plateforme data fragile, c’est comme piloter un avion sans ailes ! Chez Smartpoint, c’est devenu le mantra de nos consultants : l’IA générative ne pardonne pas le « à-peu-près », elle révèle au contraire l’impact de votre dette technique accumulée sur les résultats. Là où un humain repère une anomalie et l’écarte, un système d’IA l’absorbe, la réutilise et la propage à l’échelle. Un RAG en production repose sur vos actifs réels, vos référentiels, vos proccessus et les connaissances métiers.

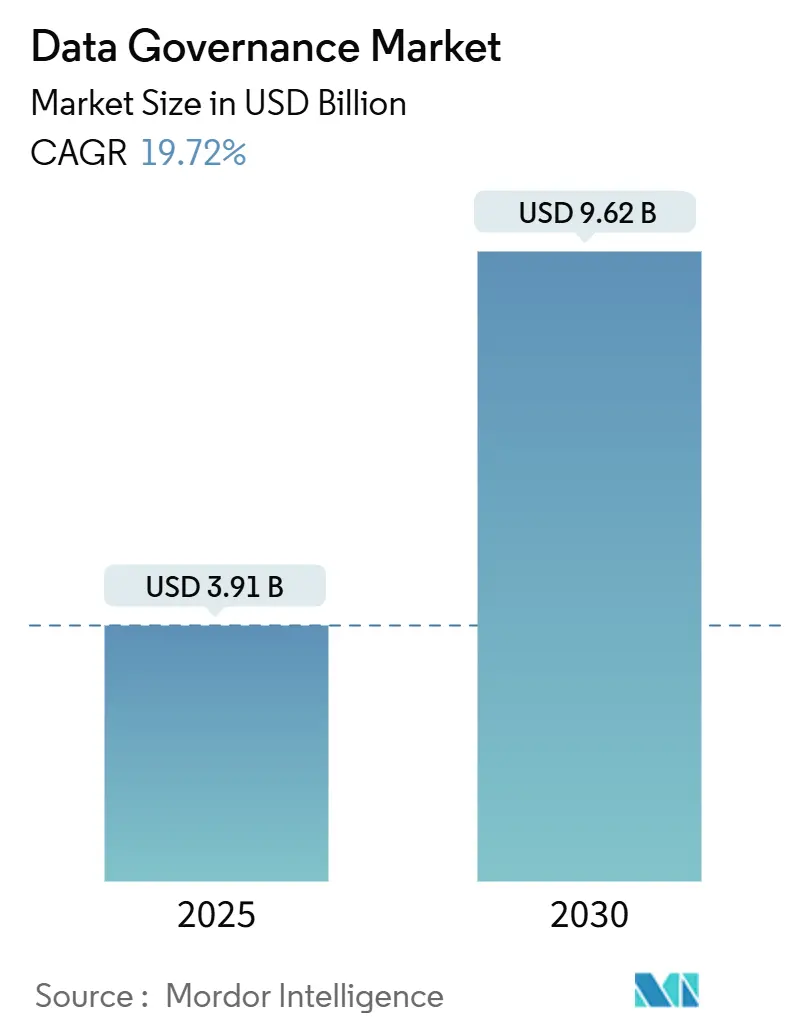

Sans une gouvernance des données solide, le meilleur modèle du monde donnera des réponses instables et creusera les failles de sécurité. La modernisation de la plateforme data n’est pas une simple migration vers le Cloud ; c’est ce qui permet de rendre vos données exploitables et traçables pour des algorithmes qui se nourrissent du contexte. De la même manière, moderniser votre plateforme BI ne sert pas qu’à accélérer les tableaux de bord, c’est préparer tout un écosystème où l’IA devient la première consommatrice de données à grande échelle.

En 2026, l’architecture RAG est préférée au Fine-Tuning pour 90% des cas d’usage en entreprise selon LlamaIndex. Cela s’explique par la capacité à maintenir un couplage dynamique et en temps réel entre le LLM et la « vérité » de vos données métier, sans les coûts ni l’inertie des cycles de réentraînement.

Un pipeline qui couvre toute l’architecture Data IA, de l’ingestion au pilotage

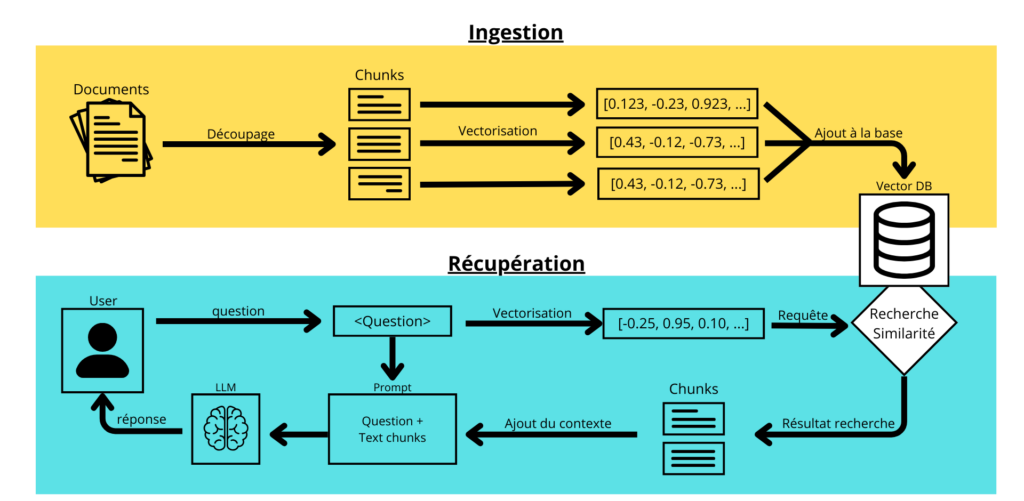

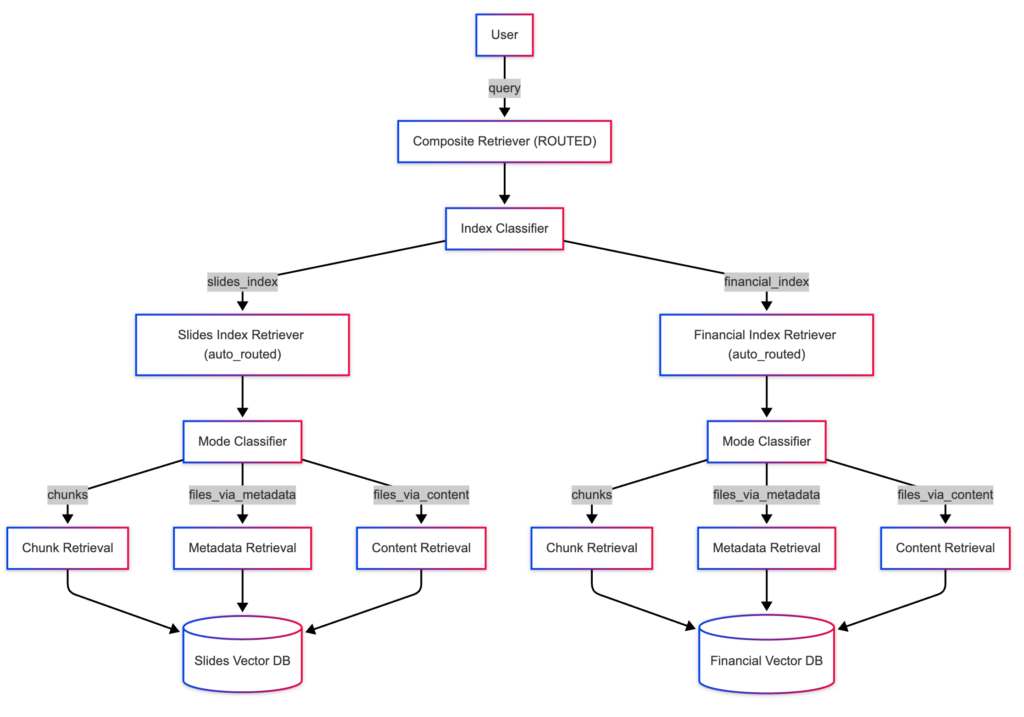

Un RAG en production n’est pas une simple « brique IA » rajoutée sur votre SI Data. C’est un pipeline d’architecture Data complète qui va de l’ingestion de la donnée brute au pilotage des performances. Chez Smartpoint, nous recommandons d’orchestrer finement chaque étape pour éviter le risque de déraillement du système. L’industrialisation d’un RAG ne commence pas avec lla base de données mais dès la saisie de l’utilisateur. Chez Smartpoint, nous intégrons systématiquement une couche de Query Rewriting (ou Query Expansion). Puisque une bonne part des échecs de l’IA sont liés à des interactions humaines imprécises ou ambiguës, nous utilisons un LLM léger pour reformuler la requête initiale en une recherche structurée et optimisée pour le moteur vectoriel. Cette étape de « nettoyage sémantique » est le premier rempart contre les hallucinations et assure que le système cherche réellement ce que l’utilisateur a en tête.

La segmentation stratégique (Semantic Chunking)

Le premier écueil technique est l’ingestion et la segmentation (Chunking strategy). Il est absolument nécessaire de découper l’information pour qu’elle reste sémantiquement cohérente. Sans un découpage sémantique maîtrisé, les taux d’hallucinations oscillent entre 12% et plus de 20% selon les modèles, ce qui rend le système IA totalement inexploitable. Au-delà du simple découpage, nos experts Data IA préconisent l’adoption de stratégies de Parent-Child Retrieval (ou Small-to-Big). Le défi ide la mise à l’échelle est en effet souvent contradictoire… Pour une recherche vectorielle précise, il faut des segments courts, mais pour une génération de qualité, le LLM a besoin d’un contexte étendu. Chez Smartpoint, nous résolvons ce paradoxe en indexant des micro-segments (les « enfants ») pour la précision du retrieval, tout en renvoyant au modèle le bloc sémantique parent complet lors de l’inférence. Cette architecture garantit la pertinence technique sans sacrifier la richesse contextuelle nécessaire à une réponse exploitable.

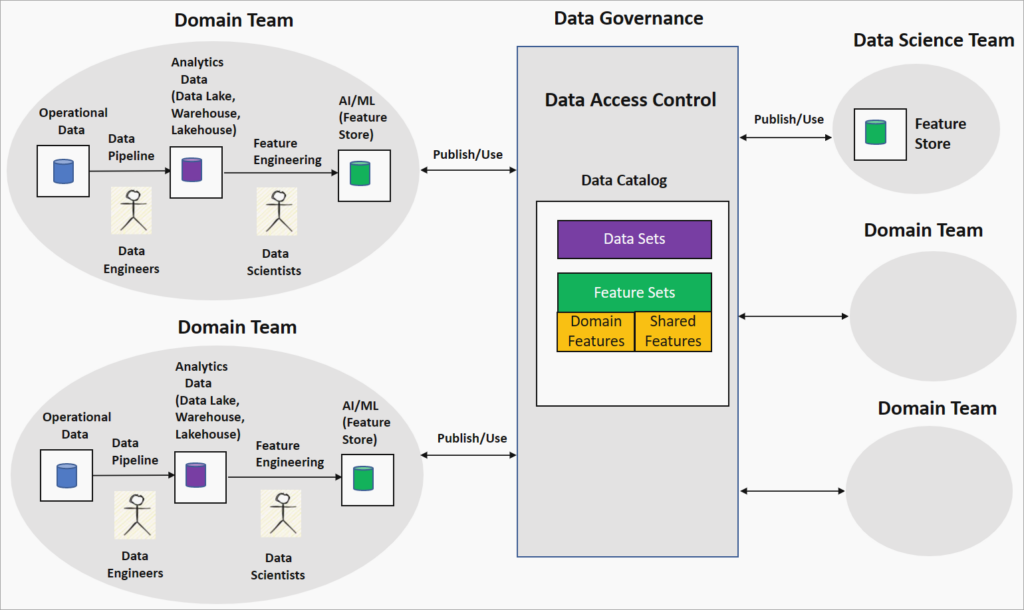

Indexation et gouvernance des droits

L’indexation vectorielle demande un arbitrage entre base de données vectorielle pure ou extension vectorielle de votre socle existant. La gestion des droits est également un prérequis non négociable. Votre système doit s’assurer que l’IA ne révèle pas à un collaborateur des informations auxquelles il n’a pas accès dans le SI source (ERP, GED, RH) … sans compter les risques de révéler ou d’exposer des données sensibles.

IA en production : les 4 piliers (qualité, sécurité, coûts, supervision)

Pour passer du POC IA agentique à l’échelle industrielle, nos experts Data IA s’assurent de la solidité de quatre piliers critiques pour être en capacités d’opérer l’IA à l’échelle.

- La Qualité (Groundedness) : L’IA se base-t-elle sur vos sources ou est-elle sujette à des hallucinations ? Votre SI agentique doit garantir une réponse vérifiable et une non-invention systématique.

- La Stabilité : Votre système résiste-t-il à la dérive (drift) ? Il est impératif de monitorer les régressions potentielles liées aux changements de corpus ou aux mises à jour des modèles LLM (versioning).

- Le FinOps : Contrôlez-vous les coûts des tokens et la latence ? Vous devez maintenir la performance sans exploser votre budget lors des montées en charge. Un piège classique en production consiste à vouloir saturer la fenêtre de contexte du modèle. Par ailleurs, nos experts Data IA surveillent de près le phénomène de Lost in the Middle, c’est à dire que la capacité d’attention des modèles s’effondre statistiquement lorsque l’information cruciale est située au centre d’un contexte trop dense. Limiter le top-k et privilégier un reranking précis n’est donc pas uniquement une stratégie de réduction de coûts FinOps pour économiser des tokens ; c’est une exigence de performance pure. En sélectionnant uniquement les segments les plus denses en information, nous évitons que le sens ne se noie dans la masse documentaire, garantissant ainsi la groundedness.

- Supervision : Observabilité / LLMOps : La journalisation, la supervision et l’amélioration continue ne sont pas optionnelles. La difficulté est dans le perpétuel mouvement de l’écosystème IA : le corpus évolue, les droits changent et les contraintes de sécurité du SI sont la règle face à une charge utilisateur souvent imprévisible.

Grille d’évaluation « AI-Ready », les critères à prendre en considération

Pour savoir si votre produit IA sera viable en production, chez Smartpoint, nous utilisons cette grille de scoring (0 : Absent, 1 : Partiel, 2 : Industrialisé). Un score supérieur à 21/30 indique que votre projet IA peut être déployé dans votre SI.

| Catégorie | Critère d’évaluation industriel | Score (0-2) |

| Cadrage | 1. Cas d’usage cadrés avec périmètre, limites et critères d’acceptation | |

| Data | 2. Corpus gouverné avec sources identifiées, versioning et dédoublonnage | |

| Metadata | 3. Métadonnées exploitables (source, date, périmètre, confidentialité) | |

| Ingestion | 4. Segmentation (Chunking) cohérente, orientée sens et réusabilité | |

| Search | 5. Recherche adaptée aux usages (hybride vectorielle / lexicale) | |

| Ranking | 6. Reranking activé et piloté par la mesure de pertinence | |

| Sécurité | 7. Filtrage par droits appliqué au retrieval et à la réponse | |

| Confiance | 8. Citations des sources visibles et exploitables par les métiers | |

| Fiabilité | 9. Gestion de la non-couverture (capacité à dire “je ne sais pas”) | |

| Évaluation | 10. Protocole d’évaluation avec jeu de requêtes représentatif | |

| Mesure | 11. Mesure de la qualité de retrieval et de la réponse (Groundedness) | |

| Traces | 12. Journalisation et traces exploitables avec rejouabilité des cas | |

| Ops | 13. Supervision et alerting (dérive sémantique et dégradation qualité) | |

| Budget | 14. Pilotage FinOps IA (coûts et latence par scénario métier) | |

| Run | 15. Exploitation outillée (Runbooks, correction et amélioration continue) |

L’IA comme système, pas comme démonstrateur

L’heure n’est plus à l’expérimentation mais à l’industrialisation ! le sujet n’est plus de « faire du RAG », mais d’opérer un RAG en production. Pour nos experts Data IA, cela suppose d’aborder l’IA générative comme un système complet et intégré, reposant sur une architecture data moderne, une gouvernance des données sans faille et une chaîne LLMOps maîtrisée de bout en bout pour garantir la stabilité face à la dérive (drift) sémantique. L’objectif est de doter votre SI d’une IA réellement opérable et pilotable, capable d’évoluer sans recréer la dette technique que l’on observe trop souvent lors du passage à l’échelle.

Chez Smartpoint, pure player data et IA à Paris, nous accompagnons les DSI et CDO pour déployer une IA générative fiable en production. Nous consolidons le socle de données et la gouvernance et nous modernisons la plateforme data, voire la plateforme BI, quand cela s’impose. Nous mettons en place une architecture RAG en production avec une évaluation continue, une supervision effective et des garde-fous clairs, afin que le système soit traçable, maîtrisé et exploitable à l’échelle.

Passez du POC à une IA générative exploitable en production

Votre pilote a fait ses preuves ? C’est ici que commence la réalité opérationnelle de l’IA. Tout l’enjeu est désormais de garantir la bonne tenue à l’échelle de l’IA, le strict respect des habilitations SI, la maîtrise de la latence et le pilotage FinOps.

Chez Smartpoint, nos experts Data IA vous proposent un atelier de cadrage pragmatique. L’objectif est d’auditer votre socle technique via notre grille de 15 critères pour définir une trajectoire de production réaliste. Nous arbitrons ensemble sur les cas d’usage prioritaires, fixons l’architecture Data cible et verrouillons les KPIs incluant la groundedness et la traçabilité des sources. Nous bâtissons un plan de mise en production sécurisé, intégrant les garde-fous et l’observabilité LLMOps nécessaires à la stabilité du système. En tant qu’ESN pure player Data et IA à Paris, nous accompagnons les DSI et CDO pour transformer ces défis en capacités durables. De la modernisation de la plateforme BI au protocole d’évaluation automatisé, nous sécurisons votre trajectoire vers une IA générative industrielle.

Contactez-nous pour activer votre feuille de route « RAG en production » et sécuriser enfin vos déploiements d’IA générative.

Architecture Data IA, modernisation plateforme data, gouvernance des données, analytics avancés ou renfort projet : que vous cherchiez un partenaire conseil ou des experts opérationnels,

Smartpoint vous accompagne, en mission comme en expertise.

Les champs obligatoires sont indiqués avec *.

Sources :

- Smartday IA : IA générative, LLM et vectorisation - prenez le contrôle !

- Building RAG Systems in 2026 With These 11 Strategies

- LlamaIndex : RAG is dead, long live agentic retrieval (2025)

- Towards AI : 11 Strategies for Building Robust RAG Systems (2025)

- McKinsey & Company : The state of AI in 2025: Agents, innovation, and transformation, L'étude de référence pour comprendre les risques d'imprécision (inaccuracy) et l'impact des agents IA sur la productivité des organisations.

Tout savoir sur l'industrialisation RAG en 2026

Selon une étude de Gartner, environ 30 % des déploiements GenAI ne passent pas l'étape de test en raison d'une mauvaise qualité des données ou de coûts d'exploitation (FinOps) mal anticipés. Chez Smartpoint, nous constatons aussi que la plupart des entreprises font face à des effets indésirables, comme des erreurs de tarification ou des hallucinations, faute d'une approche industrielle dès la phase de conception.

L’architecture RAG est préférée au Fine-Tuning pour 90 % des cas d’usage en entreprise selon LlamaIndex. Cette domination s'explique par la capacité du RAG à maintenir un couplage dynamique et en temps réel entre le LLM et la "vérité" de vos données métier, sans subir l'inertie ou les coûts élevés des cycles de réentraînement.

Sans un découpage sémantique (Semantic Chunking) maîtrisé, les taux d’hallucinations des modèles oscillent entre 12 % et plus de 20 %. Nos experts Data IA soulignent qu'un découpage incohérent empêche le modèle de saisir le contexte exact, rendant le système inexploitable pour des processus métiers critiques.

La stratégie Parent-Child Retrieval consiste à indexer des micro-segments (les "enfants") pour garantir la précision lors de la recherche vectorielle, tout en fournissant au LLM le bloc sémantique complet (le "parent") lors de la génération. Chez Smartpoint, nous utilisons cette méthode pour concilier performance de recherche et richesse contextuelle de la réponse.

Le phénomène de Lost in the Middle survient lorsque la capacité d'attention d'un modèle s'effondre au centre d'un contexte trop dense. Pour contrer cela, nos experts Data IA recommandent de limiter le top-k et d'utiliser un reranking précis afin de ne transmettre au modèle que les segments les plus denses en information.